一种人脸识别攻击对抗性补丁生成方法及装置

本发明涉及计算机视觉,具体涉及一种人脸识别攻击对抗性补丁生成方法及装置。

背景技术:

1、深度神经网络在图像分类、文字识别、目标检测、人脸识别等任务中表现出卓越的性能。然而,即使是基于深度神经网络人脸识别技术,也有可能存在一些难以通过人工检测发现的安全隐患。最新的研究表明,深度神经网络容易对对抗样本(adversarial example)产生错误的判断。与其他攻击不同的是,对抗样本攻击主要发生在模型测试和部署阶段,可如正常数据一样输入模型并得到欺骗的结果,近年来被广泛应用于攻击深度神经网络,是计算机视觉和人工智能安全领域一个重要的研究方向。

2、随着人工智能技术日新月异的发展和融合,智慧城市、智慧电商、智能医疗、智能安防等概念越发受到人们的关注。人工智能取得飞速发展,离不开深度神经网络的出现。虽然深度神经网络在各种识别任务上的准确度超过了人类,但是它们本身具有脆弱性,容易受到对抗样本的攻击。在人脸识别领域,对抗攻击会包括身份冒充和身份隐藏这两类。

3、身份冒充攻击指的是有目标的攻击,攻击者会佩戴上对抗性眼镜、对抗性贴纸等物理攻击介质,从而达到冒充指定身份的目的,主要应用场景有破解手机面部解锁、冒充他人身份刷脸支付、冒充他人进人高安保级别的场所等。

4、身份隐藏攻击指的是无目标的攻击,攻击者佩戴上对抗性口罩、对抗性帽子等,让模型无法正确识别攻击者的身份,从而达到避开天网追查的目的。

5、对抗样本最开始提出是用于欺骗分类模型,通过添加人眼微不可察的扰动来生成对抗样本,进而实现让模型无法正确输出分类结果的目的。具体来说就是将对抗性扰动沿着模型梯度相反的方向进行改变,将扰动定义为ε,使得添加了扰动的干净样本偏离了原始的分类区域,进入到目标类别区域,从而达到模型以高置信度给出一个错误输出的目的。该方法对于人眼来说难以分辨,应用在数字空间下具有非常高的隐蔽性。然而,由于这种扰动太过于微小,而物理对抗攻击需要将对抗样本打印之后再重新通过传感器(如相机)来捕捉,微小扰动会被物理世界中的噪声等因素所掩盖,因此无法将其应用在现实世界中的物理攻击。

6、考虑到物理空间的各种限制,物理对抗攻击不再将扰动限制在人眼难以察觉的噪声中,而是把扰动限制在一个较小的、没有扰动约束的局部区域内而生成的一小块补丁。对抗补丁具有鲁棒性、通用性、迁移性的特点,不仅能够有效地实现数字空间下的攻击,而且很适合应用于现实世界中的物理攻击,因此受到了许多研究者的关注。

7、针对人脸识别的对抗补丁相较于微小扰动而言,具有适用于物理空间下攻击的特点。然而,现有的人脸对抗补丁往往只考虑针对单个模型进行攻击然后迁移攻击到其他模型,并且补丁的位置往往是人为设定的,比如眼镜、鼻子、口罩等,并未考虑到补丁的位置对于攻击的效果会带来什么样的影响,也没有考虑到人脸识别系统可能采用多个模型进行决策判断的情况。在实际应用中,在一个白盒模型上攻击成功了,并不一定能攻击成功黑盒人脸识别系统。对于未知模型的黑盒人脸识别系统来说,模型的架构、参数、训练时用的数据集都是未知的,因此,多数情况下会攻击失败,因此很难起到检测人脸识别系统漏洞的作用。

技术实现思路

1、针对现有技术中存在的缺陷,本发明的目的在于提供一种人脸识别攻击对抗性补丁生成方法及装置,能够解决现有技术中对抗补丁在一个白盒模型上攻击成功了,并不一定能攻击成功黑盒人脸识别系统,导致很难起到检测人脸识别系统漏洞作用的问题。

2、为达到以上目的,本发明采取的技术方案是:

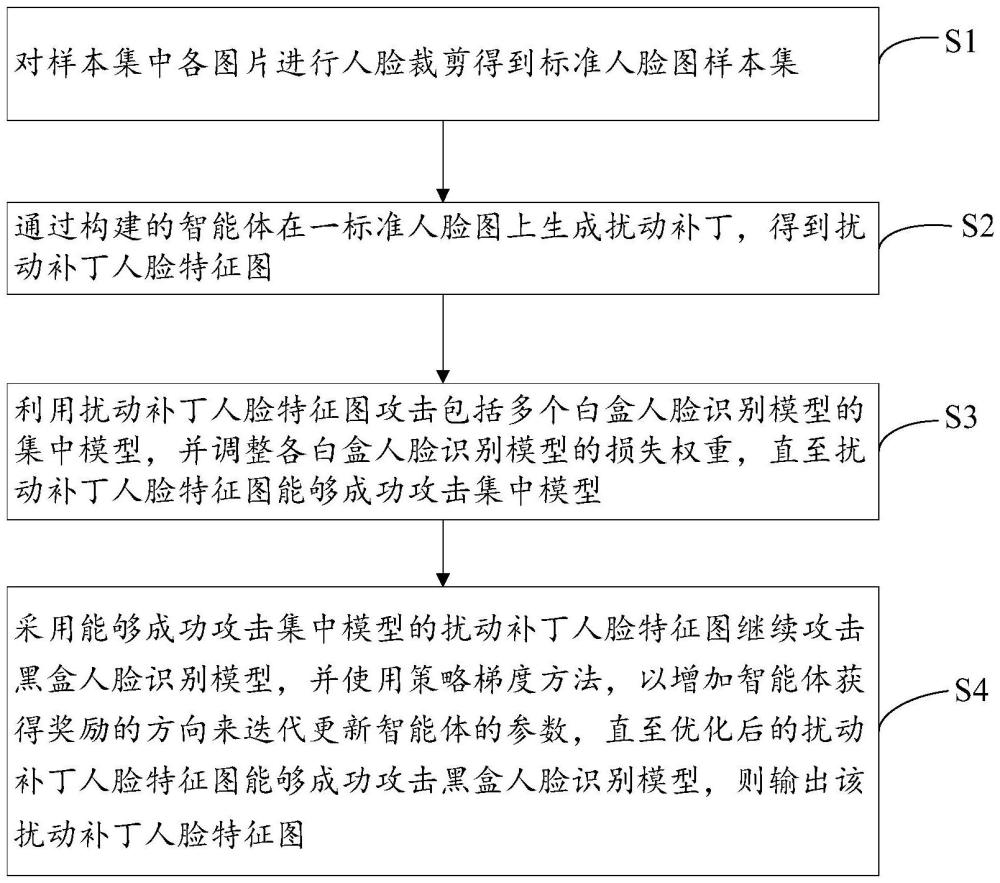

3、一方面,本发明提供一种人脸识别攻击对抗性补丁生成方法,包括以下步骤:

4、对样本集中各图片进行人脸裁剪得到标准人脸图样本集;

5、通过构建的智能体利在一标准人脸图上生成扰动补丁,得到扰动补丁人脸特征图;

6、利用扰动补丁人脸特征图攻击包括多个白盒人脸识别模型的集中模型,并调整各白盒人脸识别模型的损失权重,直至扰动补丁人脸特征图能够成功攻击集中模型;

7、采用能够成功攻击集中模型的扰动补丁人脸特征图继续攻击黑盒人脸识别模型,并使用策略梯度方法,以增加智能体获得奖励的方向来迭代更新智能体的参数,直至优化后的扰动补丁人脸特征图能够成功攻击黑盒人脸识别模型,则输出该扰动补丁人脸特征图。

8、在一些可选的方案中,所述的对样本集中各图片进行人脸裁剪得到人脸特征图样本集,包括:

9、将多张不同人的生活照使用人脸检测模型将每张图片中的人脸检测并裁剪出来;

10、将裁剪的人脸图像规范化为设定尺寸的人脸图像,得到标准人脸图样本集。

11、在一些可选的方案中,所述的通过构建的智能体利在一标准人脸图上生成扰动补丁,得到扰动补丁人脸特征图,包括:

12、基于u-net架构,设计强化学习智能体,所述强化学习智能体用于学习更新补丁位置参数和调整攻击步长;

13、将标准人脸图输入至强化学习智能体中,在人脸特征图上生成扰动补丁,得到扰动补丁人脸特征图。

14、在一些可选的方案中,所述的利用扰动补丁人脸特征图攻击包括多个白盒人脸识别模型的集中模型,并调整各白盒人脸识别模型的损失权重,直至扰动补丁人脸特征图能够成功攻击集中模型,包括:

15、利用扰动补丁人脸特征图分别攻击包括若干个白盒人脸识别模型的集成模型中的各个识别模型;

16、获取扰动补丁人脸特征图攻击白盒人脸识别模型的损失,当集成模型的集体损失大于设定值,则基于高斯分布更新各白盒人脸识别模型的损失权重,直至扰动补丁人脸特征图能够成功攻击集中模型。

17、在一些可选的方案中,各白盒人脸识别模型的损失权重ρi根据公式确定,其中,li为第i个计算人脸相似度模型的损失计算函数,fi为第i个白盒人脸识别模型,n为白盒人脸识别模型的数量,x为样本,y*表示目标样本标签。

18、在一些可选的方案中,所述的采用能够成功攻击集中模型的扰动补丁人脸特征图继续攻击黑盒人脸识别模型,并使用策略梯度方法,以增加智能体获得奖励的方向来迭代更新智能体的参数,直至优化后的扰动补丁人脸特征图能够成功攻击黑盒人脸识别模型,则输出该扰动补丁人脸特征图,包括:

19、利用能够成功攻击集中模型的扰动补丁人脸特征图继续攻击黑盒人脸识别模型;

20、基于扰动补丁人脸特征图攻击黑盒人脸识别模型的结果,使用策略梯度方法,以增加强化学习智能体获得最大回报的方向来迭代更新强化学习智能体的参数,从而优化攻击步长和补丁位置参数,以调整扰动补丁人脸特征图的参数,直至优化后的扰动补丁人脸特征图能够成功攻击黑盒人脸识别模型,与标准人脸图样本集中任一其他标准人脸图的相似度超过阈值,则输出该扰动补丁人脸特征图。

21、在一些可选的方案中,所述补丁位置参数和攻击步长的更新策略遵循分类分布。

22、在一些可选的方案中,利用智能体在一标准人脸图上生成扰动补丁时,引入图像平滑损失函数生成补丁。

23、在一些可选的方案中,输出该扰动补丁人脸特征图后,打印该扰动补丁人脸特征图,将扰动补丁人脸特征图中的对抗补丁裁剪出来,用作物理对抗攻击。

24、另一方面,本发明提供一种人脸识别攻击对抗性补丁生成装置,包括:

25、样本裁剪模块,其用于对样本集中各图片进行人脸裁剪得到标准人脸图样本集;

26、补丁生成模块,其用于通过构建的智能体利在一标准人脸图上生成扰动补丁,得到扰动补丁人脸特征图;

27、白盒攻击模块,其用于利用扰动补丁人脸特征图攻击包括多个白盒人脸识别模型的集中模型,并调整各白盒人脸识别模型的损失权重,直至扰动补丁人脸特征图能够成功攻击集中模型;

28、黑盒训练模块,其用于采用能够成功攻击集中模型的扰动补丁人脸特征图继续攻击黑盒人脸识别模型,并使用策略梯度方法,以增加智能体获得奖励的方向来迭代更新智能体的参数,直至优化后的扰动补丁人脸特征图能够成功攻击黑盒人脸识别模型,则输出该扰动补丁人脸特征图。

29、与现有技术相比,本发明的优点在于:本发明利用扰动补丁人脸特征图攻击包括多个白盒人脸识别模型的集中模型,并调整各白盒人脸识别模型的损失权重,直至扰动补丁人脸特征图能够成功攻击集中模型;然后采用能够成功攻击集中模型的扰动补丁人脸特征图继续攻击黑盒人脸识别模型,并使用策略梯度方法,以增加智能体获得奖励的方向来迭代更新智能体的参数,直至优化后的扰动补丁人脸特征图能够成功攻击黑盒人脸识别模型,则输出该扰动补丁人脸特征图。对人脸识别对抗补丁位置进行了优化,能够生成攻击成功率高、适配性强的对抗性补丁。在训练阶段,通过本发明建模出来的智能体在寻找最合适的补丁位置时非常高效,解决了对抗性补丁位置固定所带来的攻击成功率低的问题。从当前人脸识别攻击主要处于复杂的黑盒物理环境出发,将模型集成引入对抗补丁的生成过程中,并提出根据子模型的损失大小来动态调整模型的权重系数,与之前的固定模型权重系数相比,本发明充分地提高了关键替代模型的影响作用,使得对抗补丁具有更强的迁移性。

技术研发人员:王正,李柱波,卫慧

技术所有人:武汉大学

备 注:该技术已申请专利,仅供学习研究,如用于商业用途,请联系技术所有人。

声 明 :此信息收集于网络,如果你是此专利的发明人不想本网站收录此信息请联系我们,我们会在第一时间删除